Корпорация Alibaba открыла исходный код CoPaw – персональной рабочей станции для развёртывания ИИ-агентов. Инструмент, созданный на базе фреймворка AgentScope, позволяет разработчикам интегрировать ИИ-помощников в популярные мессенджеры, использовать локальные модели и управлять постоянной памятью агентов.

Единый ИИ для разных платформ

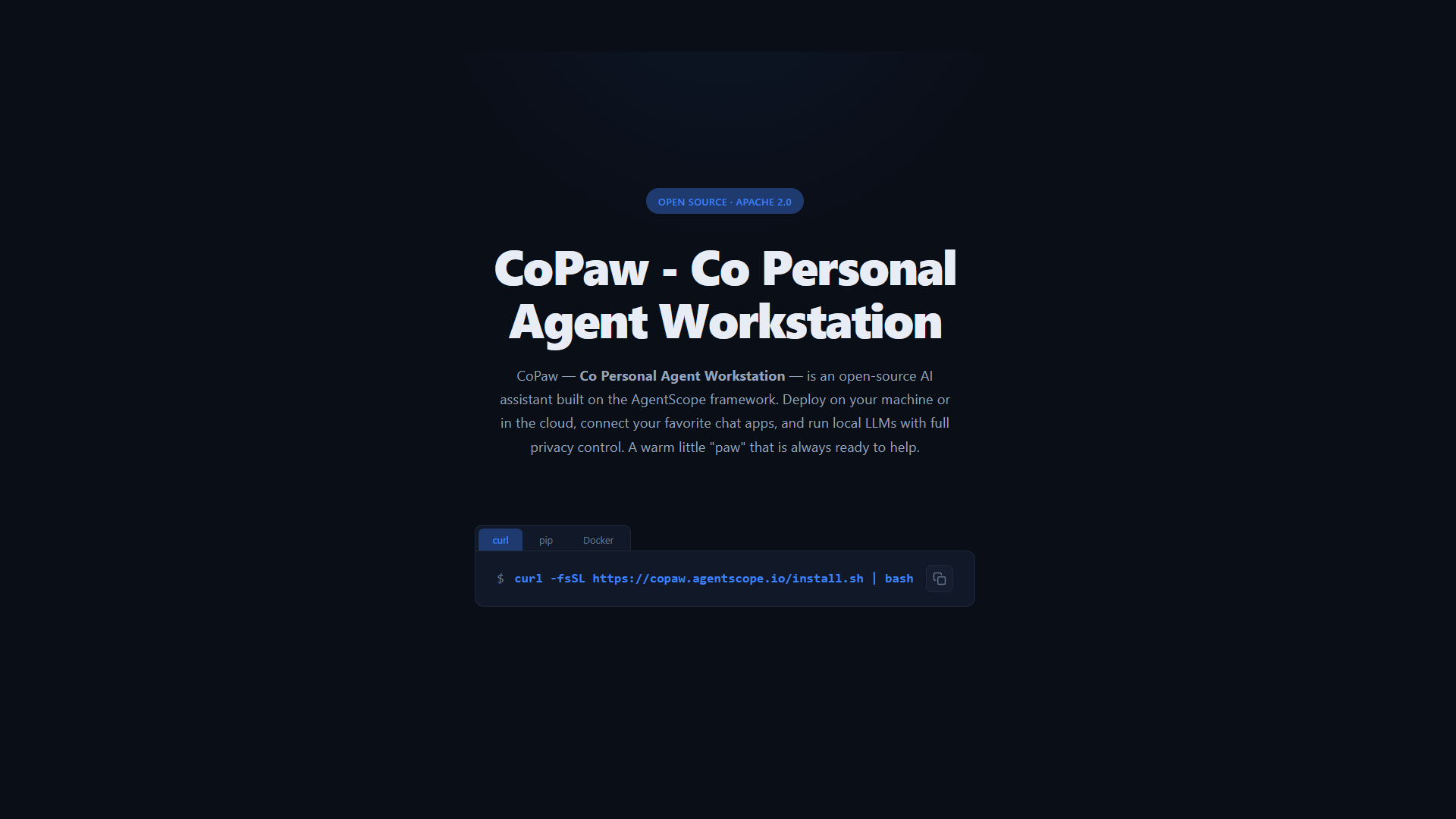

Alibaba Cloud опубликовала код CoPaw (Co Personal Agent Workstation) на GitHub под лицензией Apache 2.0. Инструмент получил нативную интеграцию с популярными платформами: DingTalk, Lark, QQ, Discord и iMessage. Это означает, что один и тот же ассистент может бесшовно функционировать сразу в нескольких каналах связи.

Архитектура CoPaw построена по модульному принципу: промпты, инструменты, механизмы памяти и хуки можно заменять независимо друг от друга. Управление интеграциями и навыками осуществляется через интерфейс командной строки (CLI).

Рабочая станция поддерживает как облачные API (включая собственную линейку моделей Qwen от Alibaba), так и полностью локальную работу. Для запуска на устройствах Apple Silicon используются llama.cpp и MLX, что позволяет разворачивать агентов без облачных зависимостей и API-ключей. В Alibaba Cloud подчёркивают, что CoPaw обладает «самым низким порогом развёртывания в отрасли» – инструмент поддерживает установку в один клик локально или через облачные сервисы Alibaba Cloud Computing Nest и ModelScope.

В перспективе разработчики планируют внедрить поддержку мультимодальных взаимодействий (голос и видео), а также гибридную систему маршрутизации запросов: простые задачи будут решаться локальными моделями для сохранения конфиденциальности, а сложные вычисления – отправляться в облако.

Новое поколение моделей Qwen

Релизу CoPaw предшествовал запуск сразу четырёх нейросетей среднего размера из семейства Qwen 3.5: Qwen3.5-Flash, Qwen3.5-35B-A3B, Qwen3.5-122B-A10B и Qwen3.5-27B.

Особое внимание разработчики уделяют модели 35B-A3B. При общем объёме в 35 миллиардов параметров она активирует лишь 3 миллиарда на один запрос, но при этом обходит по всем бенчмаркам более тяжелую модель предыдущего поколения (Qwen3-235B-A22B). Модель 122B-A10B, активирующая 10 миллиардов параметров, способна обрабатывать контекст объёмом более миллиона токенов на серверных GPU. А плотная модель 27B поддерживает контекстное окно свыше 800 тысяч токенов.

«Развитие достигается за счёт улучшения архитектуры, качества данных и обучения с подкреплением, а не просто путём бесконечного наращивания параметров», — отметили создатели Qwen в своём обращении.

ИИ-стратегия Alibaba

Выпуск CoPaw и средних моделей Qwen 3.5 стал логичным продолжением агрессивной экспансии Alibaba на рынке искусственного интеллекта. В середине февраля корпорация представила свою флагманскую модель Qwen 3.5 с 397 миллиардами параметров и открытыми весами. Как сообщается, компания заявляет о производительности, сопоставимой с топовыми решениями от OpenAI, Anthropic и Google DeepMind. Новая версия поддерживает 201 язык против 82 в предыдущем поколении.

Эти шаги подтверждают заявления генерального директора Alibaba Эдди Ву, который прошлой осенью анонсировал превышение запланированных инвестиций в ИИ-инфраструктуру. Кроме того, корпорация развивает партнёрство с Nvidia для интеграции инструментов разработки в сфере робототехники и беспилотных автомобилей на базе Alibaba Cloud.