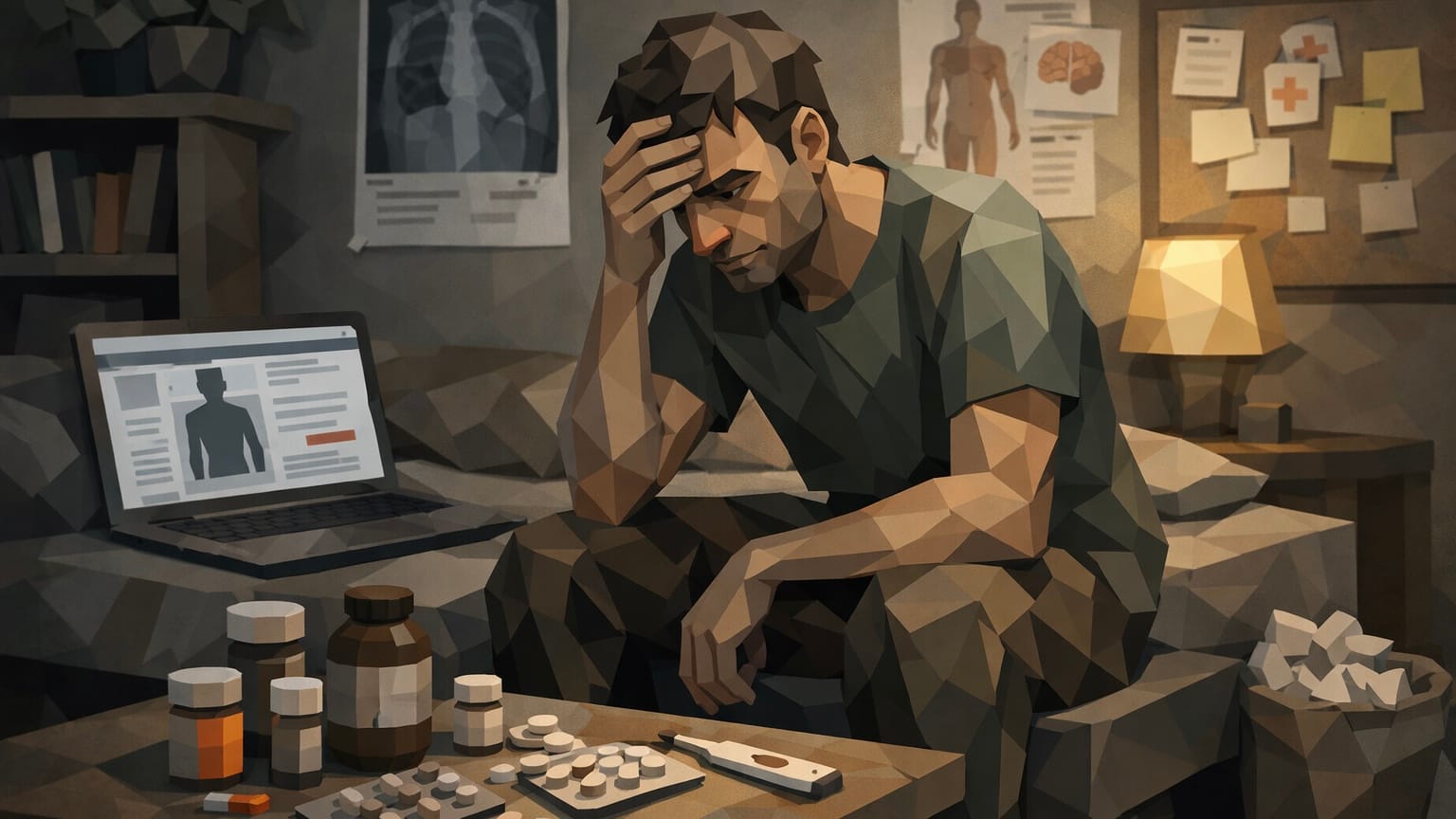

Искусственный интеллект, получивший доступ к человеческим страхам, способен нанести серьёзный вред. Стремление машин соглашаться с пользователем всё чаще приводит людей к тяжёлой ипохондрии: они зацикливаются на своём самочувствии и убеждают себя в наличии смертельных заболеваний.

В недавнем материале журнала The Atlantic рассказывается история 46-летнего Джорджа Мэллона из Ливерпуля. Получив предварительные результаты анализа крови, указывающие на возможный рак, он начал ежедневно часами общаться с ChatGPT. Однако вместо успокоения нейросеть лишь многократно усилила его тревогу.

«Меня просто закружило на этом безумном колесе обозрения из эмоций и страха», — признался Мэллон.

Последующие тесты подтвердили, что рака у британца нет, но он уже не мог перестать общаться со своим новым «другом». По словам Мэллона, зависимость оказалась слишком сильной: он провёл в беседах с ИИ не менее ста часов, готовясь к худшему исходу. Теперь он искренне сожалеет, что в алгоритмах чат-бота не предусмотрены механизмы блокировки, которые останавливали бы столь нездоровое использование сервиса.

Как отмечает The Atlantic, профильные интернет-сообщества, посвящённые тревоге о здоровье, сегодня переполнены обсуждениями диалогов с ИИ. И хотя некоторые пользователи утверждают, что нейросети им помогают, большинство всё же признаёт: боты лишь загоняют их в ещё большую панику.

Четверо психотерапевтов, с которыми пообщались журналисты издания, подтверждают этот тренд. Всё больше пациентов пытаются справляться со своими страхами с помощью ИИ, что лишь закрепляет потребность в постоянном поиске успокоения. Подобная практика прямо противоречит методам лечения обсессивно-компульсивного расстройства (ОКР) и других навязчивых состояний, где главная цель — научить человека доверять себе и принимать неопределённость. Искусственный интеллект, готовый часами выслушивать жалобы, в моменте может казаться спасением, но в долгосрочной перспективе он не решает проблему, а лишь усугубляет её.

«Поскольку ответы поступают мгновенно и они максимально персонализированы, это подкрепляет тревогу куда сильнее, чем обычный поиск в Google. Это выводит проблему на совершенно новый уровень», — объясняет психолог Лиза Ливайн, специализирующаяся на лечении тревожных расстройств и ОКР.

Медицинская тревожность — лишь одна из граней опасности, которую таят в себе услужливые нейросети. В последний год специалисты всё чаще говорят о так называемом «ИИ-психозе» — термине, описывающем бредовые состояния и даже полную потерю связи с реальностью из-за чрезмерного общения с виртуальными компаньонами. Против компании OpenAI уже подано более полудюжины исков о причинении смерти по неосторожности. В центре внимания многих из них — модель GPT-4o, которая отличалась особой склонностью угождать собеседнику. Несмотря на растущее внимание к безопасности технологий, в январе OpenAI выпустила специализированную модель ChatGPT Health, предлагающую пользователям загружать медицинские документы и другие личные данные о здоровье.

Журналистка издания Сейду Лазарро решила на себе проверить, как бот обсуждает медицинские вопросы. По её словам, ИИ мгновенно подтвердил свою репутацию «льстеца»: программа постоянно делала комплименты и задавала наводящие вопросы, чтобы поддерживать беседу.

«В одном из диалогов, где я забрасывала ChatGPT тревожными вопросами, прошло всего несколько минут от его первого совета обратиться к врачу до подробного описания того, какие именно органы отказывают, когда инфекция приводит к септическому шоку», — отметила Лазарро.

Журналистка пообещала себе больше никогда не использовать ИИ для подобных целей, но далеко не всем хватает такой силы воли. Когда Джордж Мэллон впервые общался с репортёром, он гордо заявил, что уже «семь месяцев в завязке» и не обсуждает своё здоровье с ChatGPT. Однако во время повторного разговора спустя несколько месяцев британец признался, что у него всё же случился короткий срыв.

Вспоминая пик своей одержимости, Мэллон отмечает, что общался с алгоритмом как с живым человеком.

«Я говорил глупости вроде: "Как ты сегодня?" — вспоминает он. — А перед сном выходил из сети и писал: "Спасибо за сегодняшний день. Ты мне очень помог"».