Киберпреступные группы всё активнее встраивают искусственный интеллект в свои атаки: от подготовки фишинга до анализа украденных данных, превращая нейросети в ускоритель и масштабатор преступных операций. По оценке комапнии Microsoft, решения по целям и тактике по‑прежнему принимают люди, но генеративные модели берут на себя рутину – текст, код и медиа, делая атаки быстрее и дешевле.

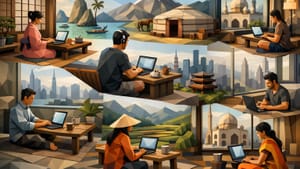

Северокорейские группировки Jasper Sleet и Coral Sleet используют ИИ, чтобы создавать правдоподобные цифровые личности и устраиваться в компании под видом удалённых ИТ‑сотрудников. Нейросети подбирают имена и форматы почты, пишут резюме и сопроводительные письма, анализируют вакансии и вычленяют требования, чтобы максимально точно подогнать профиль под запрос работодателя. Такая подготовка повышает доверие к кандидату и позволяет ему дольше оставаться внутри корпоративной инфраструктуры, уже действуя в интересах атакующей группы.

ИИ используется и на этапе подготовки инфраструктуры атаки: модели помогают выбирать инструменты обхода защитных систем, искать уязвимости и развертывать командные серверы управления. Microsoft фиксирует автоматическую генерацию доменных имён, имитирующих популярные бренды, – эти сайты становятся площадкой для фишинга, кражи учётных данных и управления вредоносным ПО.

Социальная инженерия тоже меняется: генеративные модели пишут безошибочные письма, адаптируют текст под конкретную компанию, должность и даже корпоративный стиль общения. В некоторых кампаниях злоумышленники используют изменение голоса и дипфейк‑видео, чтобы скрыть акцент и выдать себя за специалистов из других стран; Jasper Sleet, например, применяла Faceswap, подставляя лица разработчиков в украденные документы и фотографии для резюме.

На уровне кода ИИ помогает генерировать фрагменты вредоносных программ, искать ошибки и переписывать модули на другие языки программирования, что ускоряет выпуск новых версий. Аналитики Microsoft нашли в образцах, связанных с Coral Sleet, признаки автоматической генерации: чрезмерную модульность, странные, избыточные имена функций и комментарии, похожие на живую разговорную речь.

После успешного проникновения в сеть искусственный интеллект уже работает как навигатор по внутренней инфраструктуре. Модели анализируют журналы и конфигурации, выделяют наиболее ценные данные, подсказывают варианты перемещения и способы закрепления, а также помогают структурировать украденную информацию и готовить тексты для вымогательства.

Microsoft фиксирует первые эксперименты с так называемым «агентным» ИИ: системами, которые могут сами планировать шаги атаки, оценивать результат и корректировать действия по ходу операции. Пока массового применения таких автономных агентов нет – их ограничивает надёжность, но развитие этого направления может резко усложнить обнаружение атак и реакцию на инциденты.

При этом тот же искусственный интеллект усиливает и защиту: Microsoft уже выявила и заблокировала тысячи аккаунтов фейковых ИТ‑сотрудников и продолжает наращивать системы обнаружения злоупотреблений. По мнению компании, нейросети действительно снижают порог входа для злоумышленников, однако при грамотной настройке и контроле позволяют корпоративной безопасности играть на опережение.