Недавно компания Meta* выпустила Llama 3.1 – ИИ-модель, которую пользователи могут бесплатно загрузить из Интернета и использовать на своих локальных компьютерах без каких-либо ограничений. Ответы ИИ сопоставимы с ответами ChatGPT, но модель не требует подключения к Интернету.

Всё, что требуется, – это компьютер Mac с собственным процессором от Apple, не менее 8 Гб оперативной памяти и знания о том, как загрузить модель, запустить и использовать её на Mac.

Для максимального упрощения использования Llama 3.1 доступно несколько помощников, все они бесплатны и могут быть установлены всего за пару минут.

Ollama

Небольшое приложение Ollama берёт на себя заботу о загрузке и обновлении текущей модели и работает как активный сервер в фоновом режиме, направляя запросы к модели и выводя её ответы. Приложение можно скачать по этой ссылке.

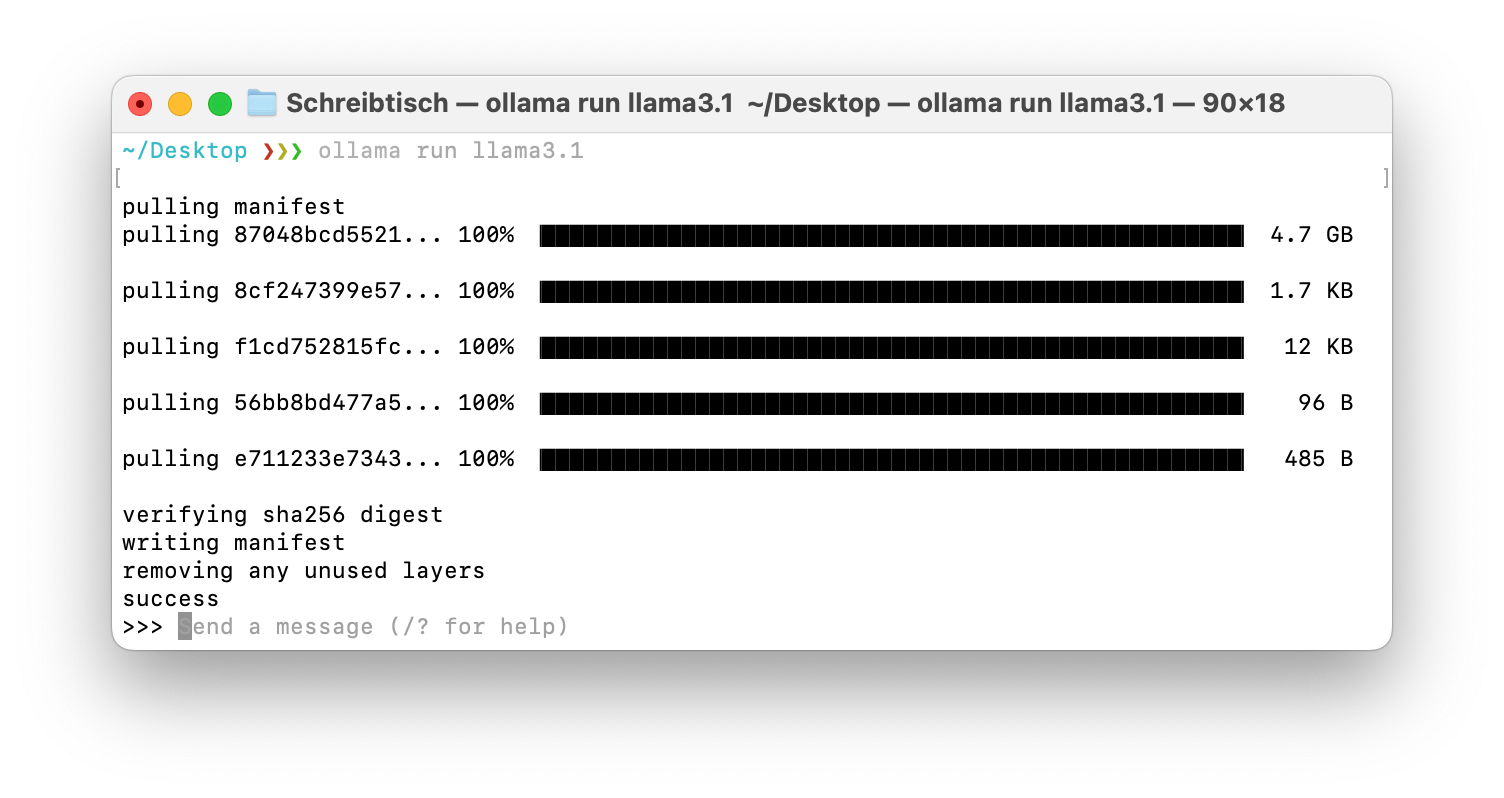

После установки Ollama вы можете использовать команду в Терминале...

ollama run llama3.1

...и загрузить текущую модель из Интернета. Для этого потребуется около 5 гигабайт свободного места на жёстком диске.

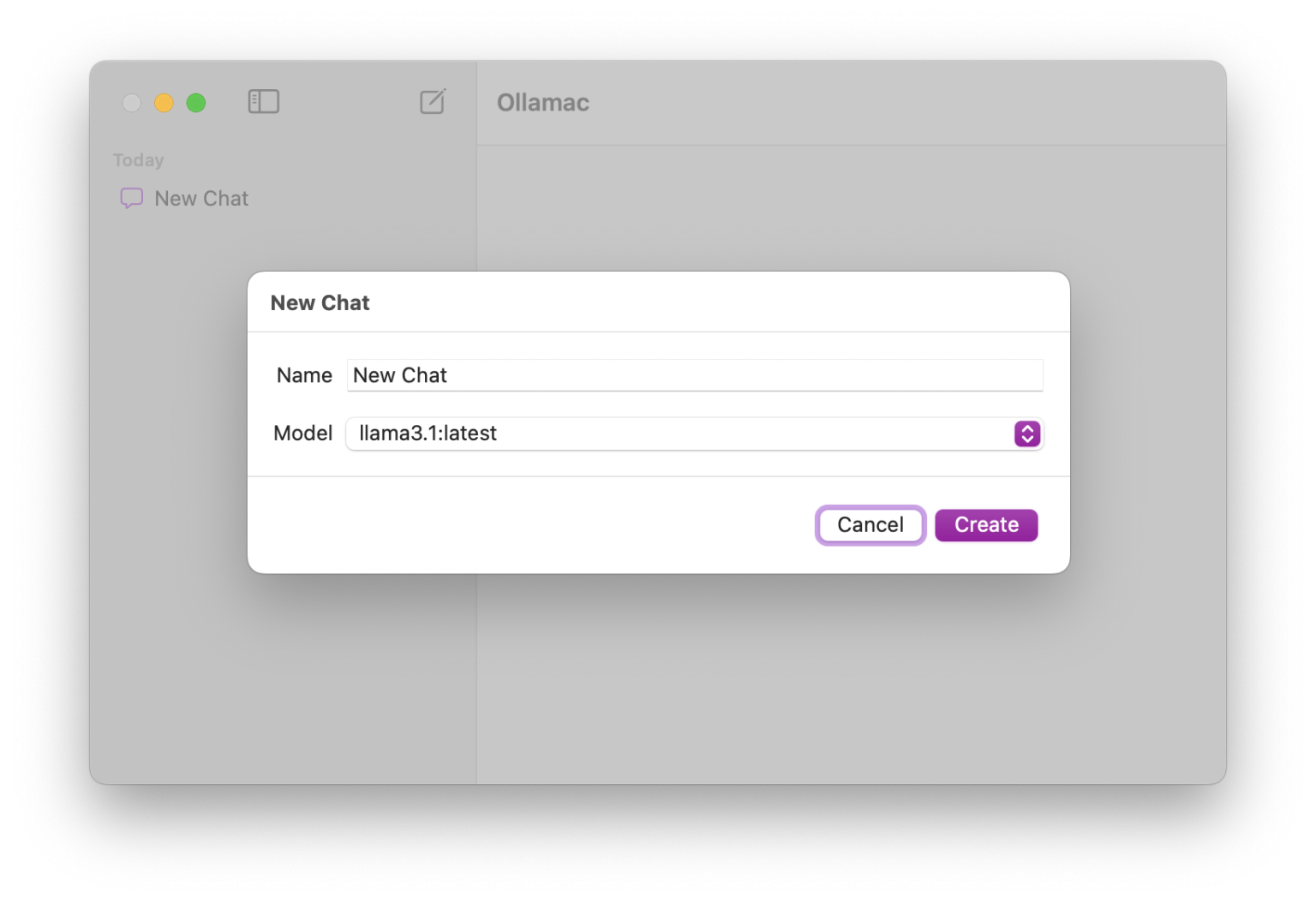

Ollamac

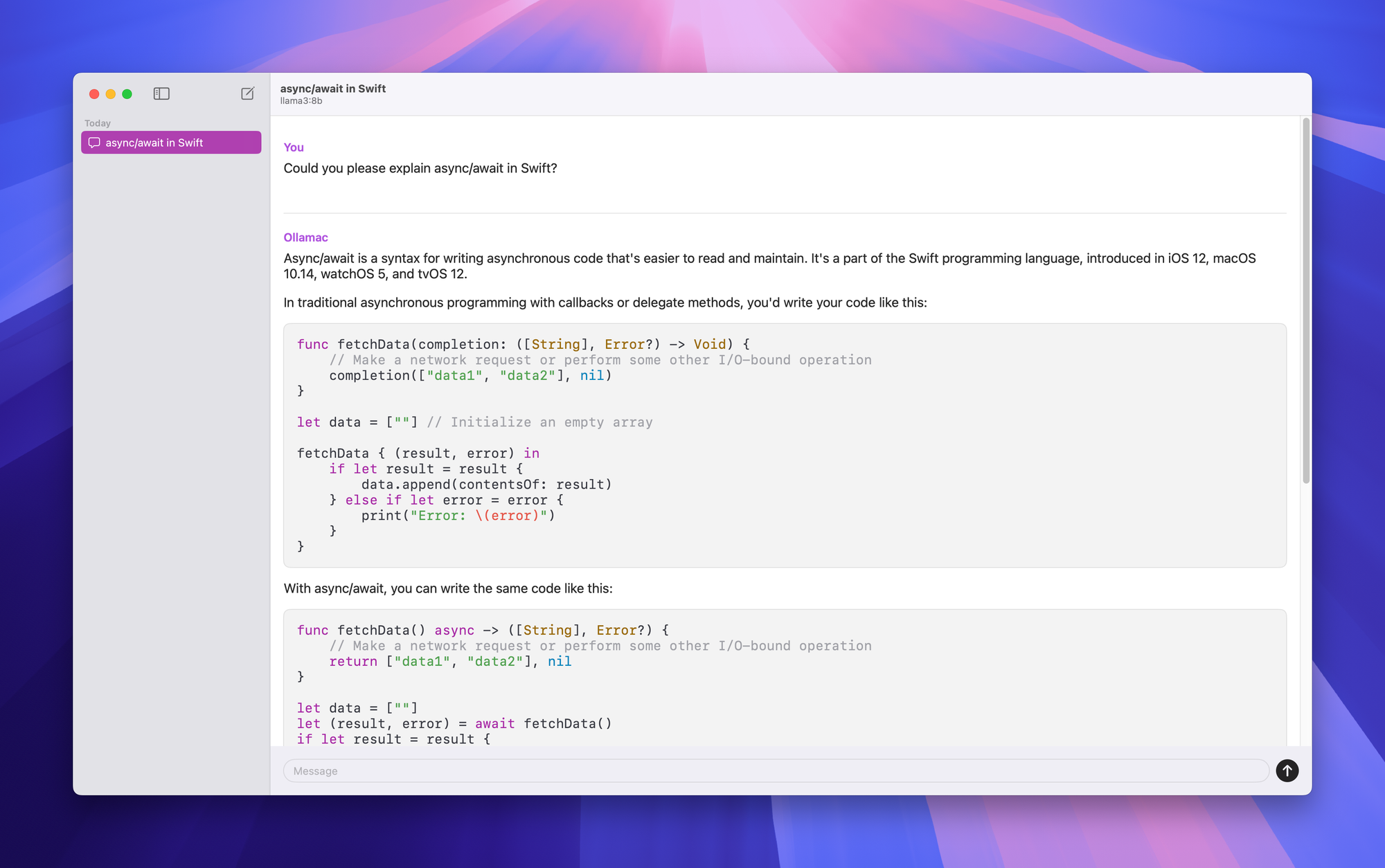

После установки Ollama вы сможете общаться с ИИ-моделью в Терминале. Однако приложение Ollamac для macOS, которое также является бесплатным, делает процесс общения гораздо более удобным.

Приложение доступно бесплатно на портале GitHub. Его можно скачать и запустить приложение сразу после запуска сервера с помощью Ollama. Или воспользоваться командой для установки с помощью Homebrew:

brew install --cask ollamac

Теперь в вашем распоряжении нативный пользовательский интерфейс с новыми чатами.

Больше ничего особенного знать не нужно. После установки Ollama и Ollamac вы сможете использовать ИИ-модель в автономном режиме сколько угодно раз без каких-либо ограничений, без потери данных и без необходимости переводить компании деньги за подписку.

Ещё по теме:

- Новый цвет iPhone 16 Pro может приобрести бронзовый оттенок

- Из-за проблем с финансами компания Intel уволит около 1000 сотрудников

- Глава Epic Games обрушился с критикой на «Локатор» от Apple