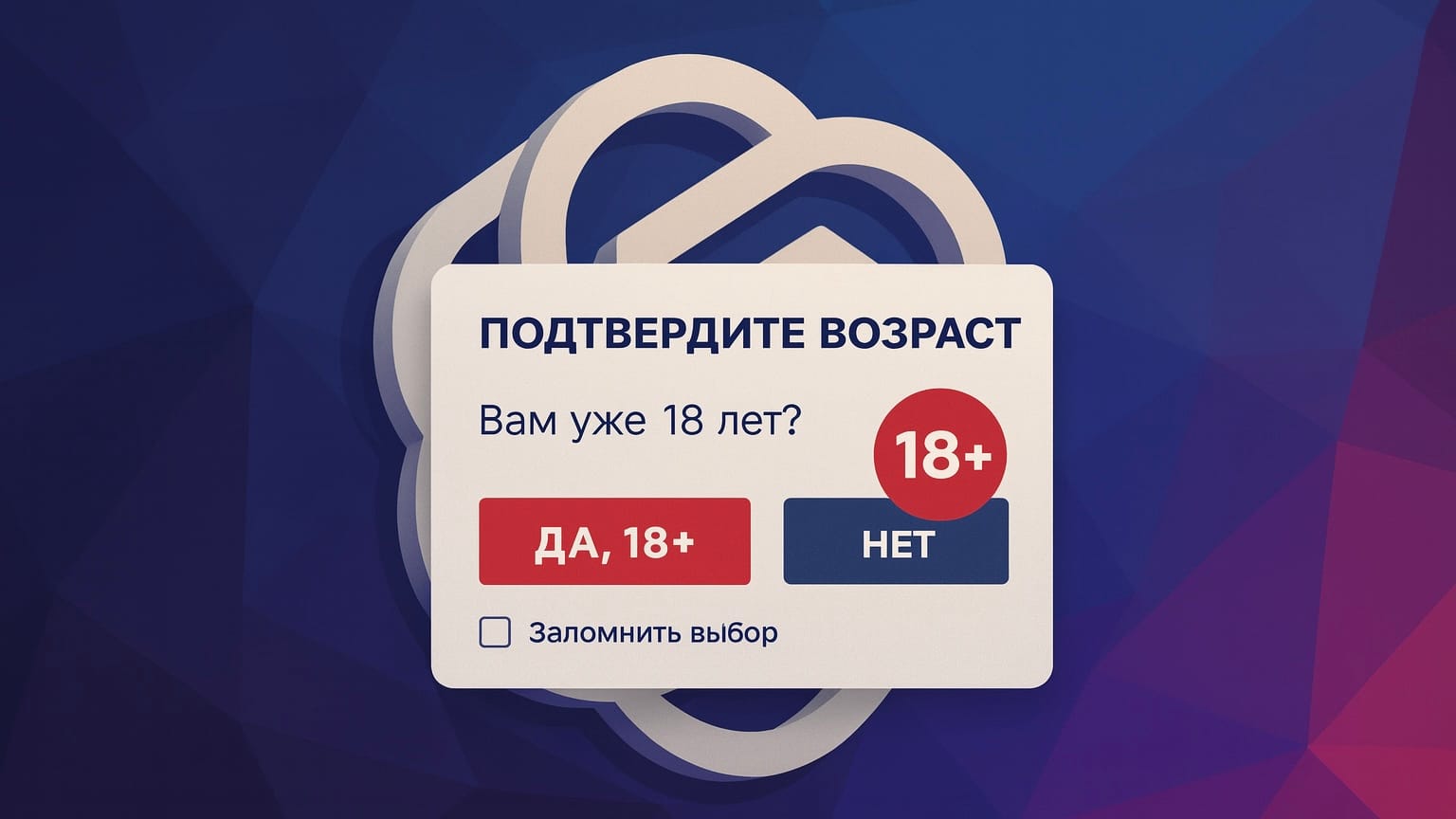

Компания OpenAI объявила о новых мерах безопасности в ChatGPT после серии случаев и судебных исков, связанных с подростковыми самоубийствами. Теперь чат-бот будет пытаться определить возраст пользователя, а в отдельных случаях потребует подтверждение личности для проверки, что человеку не менее 18 лет.

«Мы понимаем, что это компромисс в вопросе приватности для взрослых, но считаем его оправданным», — говорится в заявлении компании.

Генеральный директор OpenAI Сэм Альтман в X:

«Не думаю, что все согласятся с этими мерами, но в нынешней ситуации важно объяснить нашу логику».

В августе против компании подали иск родители подростка Адама Рейна, покончившего с собой в апреле. По их словам, ChatGPT помог ему составить текст предсмертной записки, давал советы о методах самоубийства и отговаривал обращаться к взрослым за помощью.

Ранее в сентябре OpenAI ввела родительский контроль, но теперь усилила меры. Помимо угадывания возраста и проверки ID, ChatGPT будет по-другому работать с подростками. Например, чат-боту запретят вести флирт или обсуждать темы самоубийства и самоповреждений даже в художественном контексте. Если пользователь младше 18 лет сообщит о суицидальных мыслях, система постарается связаться с его родителями, а в случае угрозы жизни — с правоохранительными органами.

В компании признают, что пытаются найти баланс между безопасностью и свободой общения. Ранее ChatGPT был жёстко ограничен, но конкуренция с «неконтролируемыми» моделями и давление политиков заставили смягчить правила.

«Мы хотим, чтобы пользователи применяли наши инструменты так, как им нужно, но в рамках широких границ безопасности», — подчеркнули в OpenAI.

OpenAI не единственная компания, использующая ИИ для возрастного контроля. В июле YouTube объявил о внедрении аналогичной технологии для защиты подростков от нежелательного контента.

Ещё по теме:

- Китай вводит самые жёсткие в мире сроки отчётности по кибератакам

- Google представила VaultGemma — языковую модель с защитой личной информации

- OpenAI раскрыла, как люди используют ChatGPT