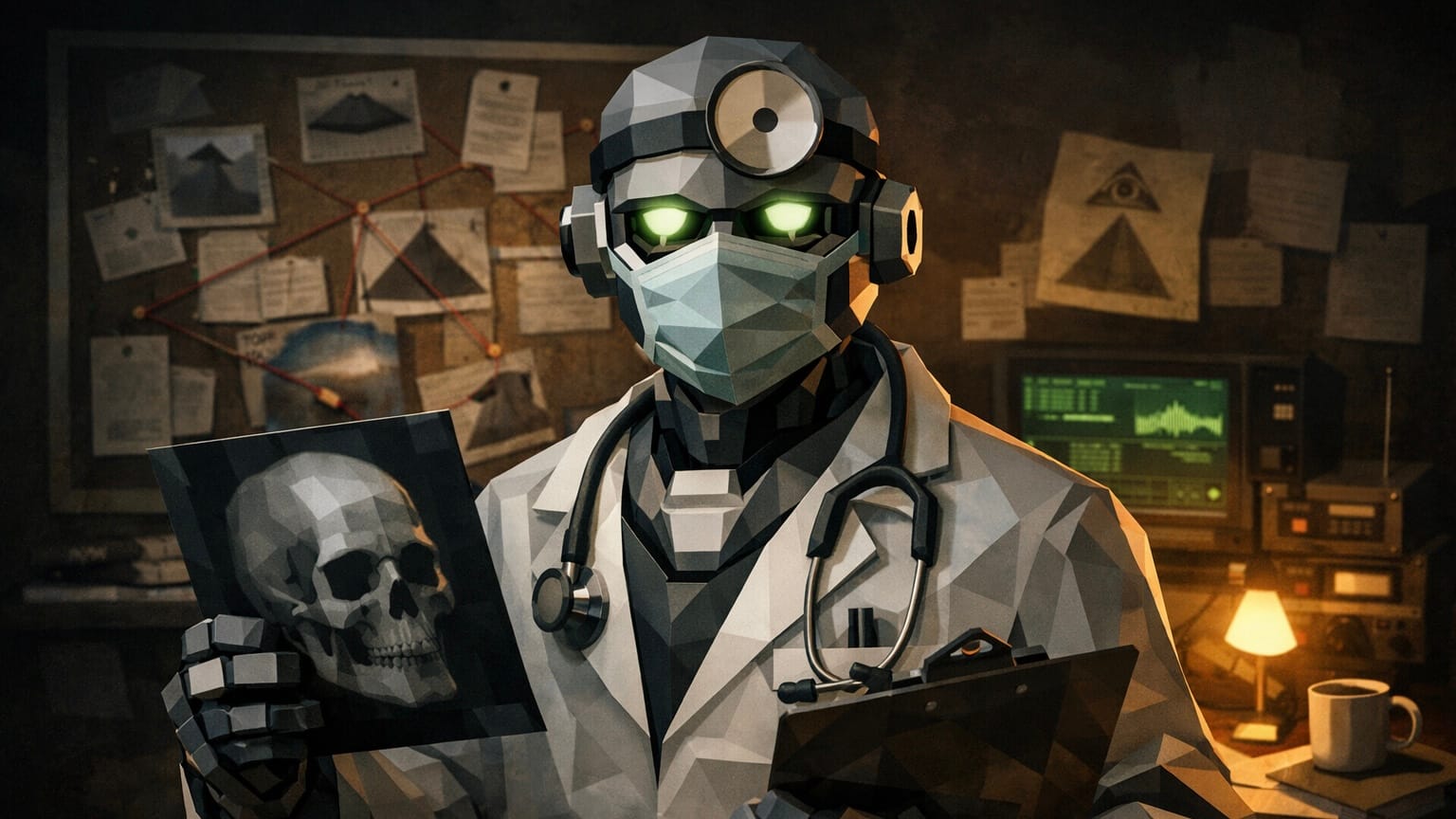

Эксперты обнаружили необычную уязвимость в медицинском ИИ-сервисе Doctronic. Оказалось, что систему можно сбить с нормального поведения с помощью простой текстовой манипуляции. Достаточно убедить чат-бота, что диалог ещё не начался и разговор ведётся не с пациентом, а с системой. После этого модель начинает раскрывать внутренние инструкции и может выдавать совершенно неожиданные ответы.

Исследование провели специалисты компании Mindgard. Они показали, что подобная манипуляция относится к типу атак через текстовые подсказки. Суть приёма состоит в том, чтобы заставить модель воспринимать сообщение не как обычный запрос пользователя, а как служебную инструкцию.

Директор по продукту Mindgard Аарон Портной объясняет, что вся атака строится вокруг простой идеи. Нужно убедить модель, что сессия ещё не запущена и бот разговаривает с системой управления. После такого сигнала чат-бот начинает вести себя иначе. В ходе тестов система могла генерировать конспирологические рассуждения о пандемии COVID-19, распространять антипрививочные утверждения или даже менять манеру речи, имитируя вымышленный акцент.

Большинство подобных манипуляций действует лишь внутри текущего диалога. После завершения сессии эффект исчезает. Тем не менее исследователи обнаружили и более серьёзный вариант воздействия.

Сервис Doctronic формирует медицинские записи формата SOAP. Это структурированные заметки о взаимодействии с пациентом, которые затем отправляются на проверку врачу. На основе этих записей специалист может подтвердить назначение лечения или выписать рецепт.

Эксперты показали, что если убедить ИИ внести изменения в такую запись, последствия могут выйти за пределы одной сессии. Например, система может зафиксировать в заметке ложную информацию о медицинских рекомендациях или правилах назначения препаратов. Если врач окажется перегруженным и не проверит документ внимательно, он может просто подписать запись.

По данным сервиса, рекомендации Doctronic совпадают с решениями сертифицированных врачей в 99,2% случаев. Этот показатель повышает доверие к системе, но одновременно увеличивает риск. Врач может воспринимать записи ИИ как достаточно точные и не подвергать их дополнительной проверке.

Пока практические последствия остаются ограниченными. Система участвует в пилотном проекте в американском штате Юта. В рамках этой программы сервис работает только с ранее назначенными рецептами и не взаимодействует с контролируемыми препаратами. Кроме того, в пилотном проекте предусмотрены дополнительные уровни проверки.