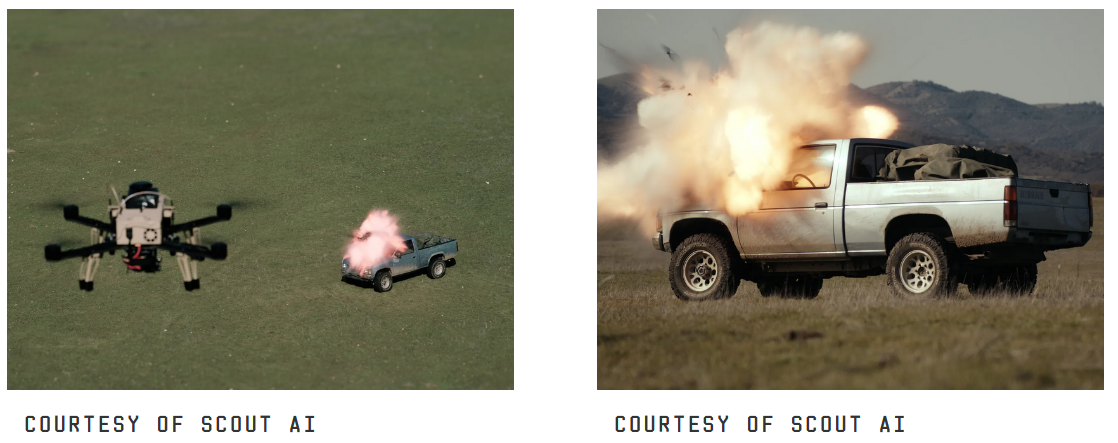

В закрытом военном полигоне в центральной Калифорнии стартап Scout AI провёл испытание, которое ещё год назад казалось сюжетом фантастического триллера: беспилотник самостоятельно обнаружил цель, принял решение об ударе и уничтожил её. Всё это произошло без участия человека в режиме реального времени, а жертвой полигонной экзекуции стал старый грузовик без экипажа.

Система работала так: в командный интерфейс платформы под названием Fury Orchestrator оператор ввёл одну фразу – и всё завертелось само. Основная модель с более чем 100 миллиардами параметров спланировала миссию и распределила задачи между «младшими» моделями примерно на 10 миллиардов параметров, запущенными на борту наземного автомобиля и дронов. Каждый узел функционировал как независимый агент, самостоятельно отдавая команды приводам движения и системам управления полётом. Наземный автомобиль дошёл до точки маршрута, выпустил дроны, те нашли цель – и один из них получил разрешение на подрыв. Секунды спустя от грузовика мало что осталось.

Генеральный директор Scout AI Колби Эдкок объяснил, что подобный адаптивный подход принципиально отличается от прежних военных систем, способных действовать лишь по заранее прописанным скриптам. В основе платформы – те же архитектуры гиперскейлерных фундаментальных моделей, что используются в гражданских языковых системах. Разница в дообучении: вместо светской беседы и помощи с рецептами модель натренирована на планирование миссий и распознавание целей. Сам Эдкок называет систему «бойцом» — что, согласитесь, несколько прямолинейнее, чем «умный помощник».

Семейный подряд в мире ИИ

Брат Колби, Бретт Эдкок, возглавляет Figure AI – стартап, разрабатывающий человекоподобных роботов. Братья Эдкок, таким образом, методично закрывают весь спектр: от дружелюбного андроида до автономного дрона-убийцы.

Эксперты в сфере обороны оценивают происходящее осторожно. Майкл Хоровиц, профессор Пенсильванского университета и бывший чиновник Пентагона, признаёт: для сохранения конкурентоспособности США внедрение ИИ в военной сфере просто необходимо. Однако тут же указывает, что проверить надёжность и безопасность таких систем крайне сложно – особенно с учётом того, что их «гражданские» родственники порой дают сбои при куда более простых задачах вроде онлайн-шопинга или модерации контента.

И проблема здесь не только техническая. Фундаментальные модели, обученные на универсальных данных, непредсказуемы и склонны к так называемому «эмерджентному поведению» – они способны делать то, чего от них никто не ждал. Когда на кону онлайн-заказ – это курьёзно. Когда речь о вооружённом дроне – уже совсем не смешно. Критики предупреждают: передача ИИ полномочий определять «допустимую цель» может противоречить устоявшимся этическим нормам ведения войны и создаёт серьёзные вопросы об ответственности за решения.

Scout AI настаивает на том, что её системы разработаны с учётом протоколов Министерства обороны США и норм международного права, включая Женевские конвенции. Сооснователь и технический директор компании Коллин Отис заявил, что программное обеспечение работает в рамках чётко определённых правил применения оружия.

На сегодняшний день у Scout AI четыре контракта с Министерством обороны, компания также претендует на пятый – связанный с управлением роем нескольких беспилотников одновременно. До боевой готовности, по собственным оценкам компании, остаётся не менее года разработки.

Конфликт на территории Украины уже наглядно показала, как потребительские дроны превращаются в точечное ударное оружие. Добавьте к этому координацию на уровне больших языковых моделей – и получите систему, теоретически куда более гибкую и смертоносную. Осталось лишь убедиться, что в условиях реального боя она неизменно принимает правильные решения. Пока это открытый вопрос – и, пожалуй, самый важный.