Существует знаменитый тест, предложенный ещё в 1950 году гениальным математиком Аланом Тьюрингом, цель которого – определить, способна ли машина демонстрировать поведение, интеллектуальное настолько, что его невозможно отличить от человеческого. Он так и называется – «Тест Тьюринга» – и считается важной вехой в изучении искусственного интеллекта. Похоже, что эта далёкая цель наконец-то достигнута, по крайней мере, если верить результатам недавнего эксперимента, в ходе которого чат-бота GPT-4 удалось принять за человека в 54% случаев разговора.

Это признак того, что ИИ становится всё более «человечным» или просто демонстрация того, как он ловко умеет обманывать наше восприятие? Безусловно, это знак того, что грань между естественным и искусственным интеллектом будет становиться всё тоньше. Со всеми вытекающими отсюда чудесами и подводными камнями.

GPT-4 обманывает каждого второго человека в тесте Тьюринга

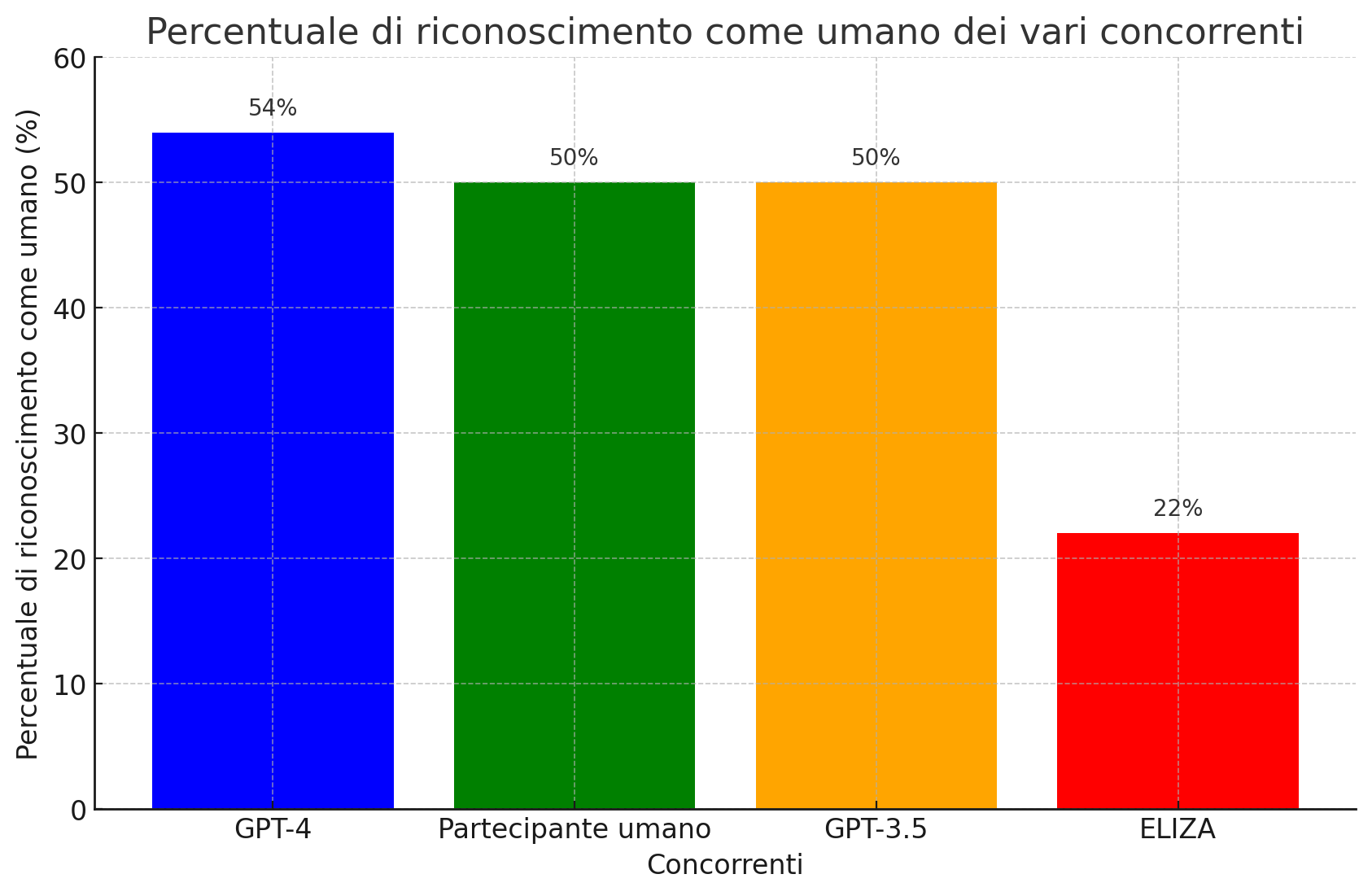

В тесте, результаты которого были опубликованы на платформе arXiv участвовали 500 человек, получивших задание в течение пяти минут беседовать с четырьмя разными собеседниками: человеком и тремя системами искусственного интеллекта.

Среди них были старая программа ELIZA, созданная ещё в 1960-х годах и основанная на заранее заданных ответах, модель GPT-3.5 и более продвинутая GPT-4, та самая, которая лежит в основе известного бота ChatGPT.

В конце бесед участников просили указать, каких собеседников они считают живыми людьми, а каких – искусственными. И тут обнаружились сюрпризы: GPT-4 удалось перепутать с человеком в 54% случаев, что даже выше, чем у участника-человека (показатель 50%). Два других цифровых «конкурента» остались далеко позади: GPT-3.5 также остановился на отметке 50%, а рудиментарная ELIZA была идентифицирована как человек только в 22% бесед.

Это очень впечатляющий результат, который, похоже, знаменует собой поворотный пункт на пути к созданию искусственных интеллектов, всё более похожих на человеческие.

Не только интеллект, но и эмпатия, и человеческие «недостатки»

Но что же делает GPT-4 настолько «человечным», что он способен обмануть большинство собеседников? По мнению экспертов, дело не только в «интеллекте» в строгом смысле, понимаемом как способность обрабатывать информацию и давать соответствующие ответы. Всё гораздо сложнее.

«Языковые модели бесконечно гибкие, они способны синтезировать ответы по широкому кругу тем, говорить на определённых языках или социальных группах и представлять себя с индивидуальными чертами характера и ценностями. Это огромный шаг вперёд по сравнению с тем, что запрограммировано человеком, пусть даже очень умно и тщательно», – Нелл Уотсон, исследователь ИИ из Института инженеров электротехники и электроники (IEEE).

Иными словами, GPT-4 не только демонстрирует знания и умение рассуждать, но и способен «поставить себя на место» собеседника, изменяя язык и отношение в зависимости от контекста. И не только: по словам Уотсон, эти продвинутые системы ИИ также демонстрируют типично человеческие черты, такие как склонность к сбивчивости, когнитивным предубеждениям и манипуляциям. Все эти характеристики делают их ещё более похожими на нас, включая недостатки. Отсюда и «триумф» в тесте Тьюринга.

Новые вызовы для человеко-машинного взаимодействия

Если машины будут всё больше и больше создавать впечатление, что они живой человек, как мы узнаем, с кем мы на самом деле взаимодействуем? Это один из вопросов, поднятых в исследовании, которое опасается риска растущей «паранойи» в онлайн-взаимодействии, особенно по чувствительным или конфиденциальным вопросам.

Этот сценарий не так уж далёк от реальности, если вспомнить, как часто мы ежедневно взаимодействуем с цифровыми помощниками, чат-ботами и другими системами искусственного интеллекта, даже не осознавая этого. При этом мы рискуем подвергнуться влиянию или манипуляции, даже не подозревая об этом.

Достоверность теста Тьюринга

Есть и ещё один вопрос, поднятый в исследовании: о реальной достоверности теста Тьюринга в качестве мерила искусственного интеллекта. По мнению самих авторов, на самом деле тест слишком упрощает подход, придавая больше значения «стилистическим и социально-эмоциональным» факторам, чем реальным интеллектуальным способностям.

Другими словами, системы, подобные GPT-4, будут очень хорошо «казаться» умными, идеально имитируя манеру человека выражать свои «мысли» и общаться, не являясь таковыми на самом деле. Эта способность рискует заставить нас переоценить их реальный IQ.

Неудивительно, что в исследовании говорится о «широкомасштабных социальных и экономических последствиях», связанных с появлением всё более «человеческого» ИИ. От потери рабочих мест до изменения социальной динамики, через риски манипуляции и дезинформации. Все эти вопросы требуют глубоких размышлений о том, какое место мы хотим отвести этим технологиям в нашей жизни.

Одним словом, «успех» GPT-4 в тесте Тьюринга – это действительно историческая веха на пути искусственного интеллекта, но он также открывает ряд острых вопросов о взаимоотношениях между человеком и машиной. Каким бы ни был ответ на эти вопросы, создаётся впечатление, что вскоре мы будем спрашивать себя, был ли этот ответ дан человеком из плоти и крови или нет.

Ещё по теме:

- Тим Кук мог встретиться с Трампом во время WWDC, чтобы обсудить приоритетные задачи нового срока

- ИИ Стив: кандидат, который хочет «очеловечить» британскую политику

- Английский механик построил самую быструю в мире тачку