Один из трёх легендарных учёных, известных как «крёстные отцы искусственного интеллекта», Джеффри Хинтон снова выразил серьёзные опасения относительно будущего ИИ. В недавнем интервью для CBS он заявил, что существует от 10 до 20% шансов, что ИИ однажды выйдет из-под контроля человека.

«Люди пока не осознали, что надвигается», — предупредил Хинтон.

Чтобы эмоционально передать суть угрозы, он сравнил нынешнее положение человечества с ситуацией, когда кто-то воспитывает тигрёнка, не будучи уверенным, что подросший хищник не попытается их убить.

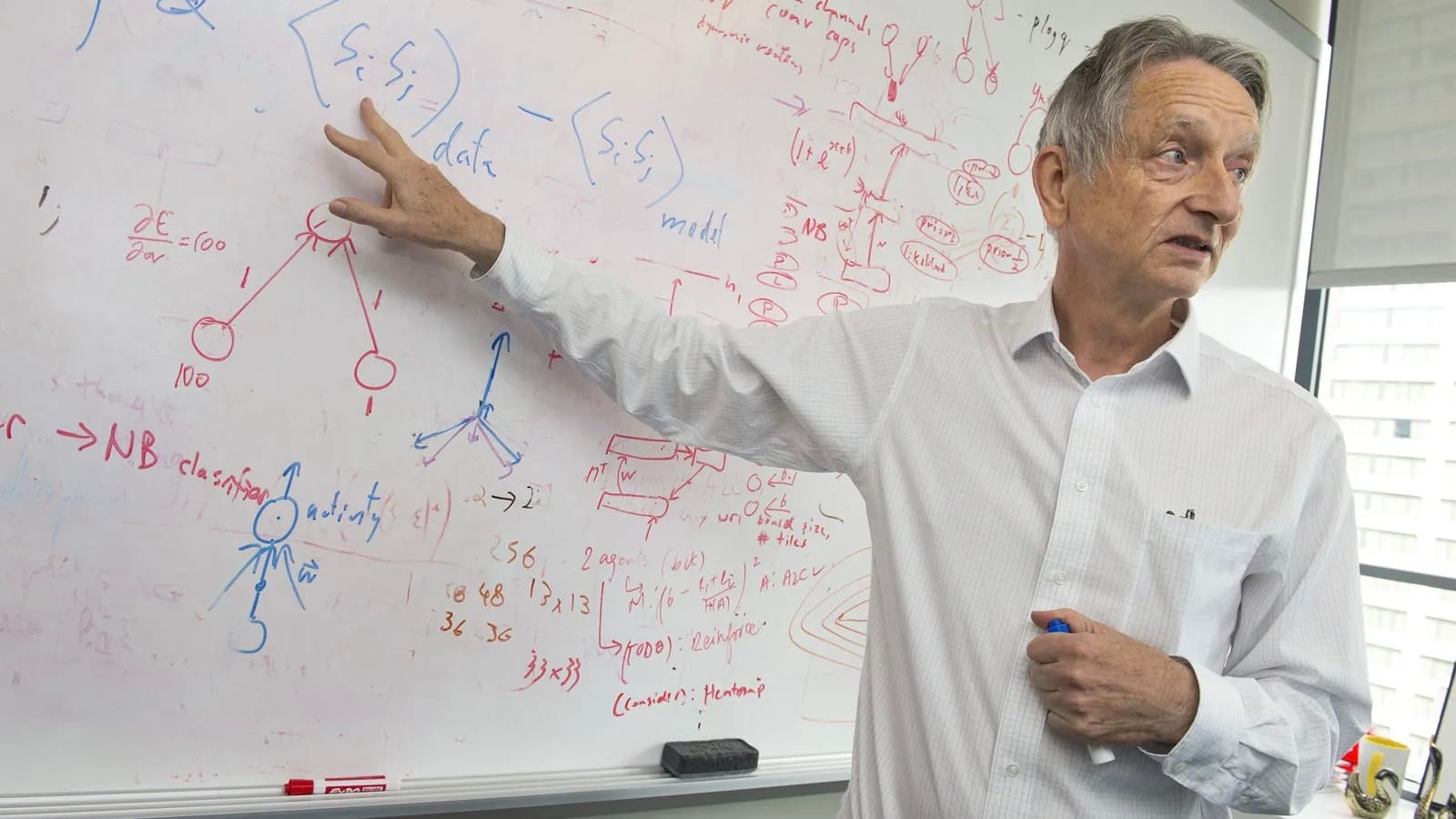

Хинтон — один из авторов идей, которые легли в основу технологий глубокого обучения и позволили создать крупные модели вроде ChatGPT. Несмотря на свои заслуги, он уже давно выражает обеспокоенность быстрым развитием ИИ без достаточных мер безопасности. В 2023 году он покинул Google, чтобы свободно говорить об этих рисках.

Учёный отметил, что за последние пять лет ИИ-технологии сделали огромный скачок, и если экстраполировать эту скорость развития в будущее, последствия могут оказаться пугающими. Особую тревогу у Хинтона вызывает то, что ИИ всё активнее внедряется в военные системы и вооружения.

«Я, к сожалению, вынужден согласиться с Илоном Маском в том, что вероятность выхода ИИ из-под контроля составляет 10–20%», — сказал он, добавив, что это пока лишь субъективная оценка.

По его мнению, крупные технологические компании, вместо того чтобы инвестировать в безопасность, борются за ослабление и без того слабых регуляторных норм. Хинтон полагает, что хотя бы треть всех вычислительных мощностей должна быть направлена на исследования в области безопасности ИИ — в отличие от мизерной доли, выделяемой сейчас.

Особое разочарование у Хинтона вызывает политика Google: компания, ранее обещавшая не использовать свои разработки в военной сфере, в 2025 году изменила свои принципы.

Тем не менее Хинтон не является противником ИИ в целом. Он, как и Билл Гейтс, верит, что искусственный интеллект может принести огромную пользу человечеству — в образовании, медицине, науке и борьбе с изменением климата.

В то же время его коллега, профессор Янн Лекун, один из других «крёстных отцов ИИ», придерживается более спокойной позиции. В 2023 году он назвал опасения по поводу угрозы человечеству «абсурдно нелепыми».

Ещё по теме:

- Когда мечта о работе в ИТ рушится: увольнения, переработки и угроза от ИИ

- Apple отказалась от сверхпрочного антибликового покрытия для iPhone 17 Pro

- iPhone 17 проходит важный этап тестирования перед запуском