Во вторник в популярной группе на Facebook*, посвящённой идентификации грибов, появился чат-бот с искусственным интеллектом под названием «FungiFriend». Однако вместо помощи он дал опасный совет: предложил пользователям «обжарить в масле» потенциально ядовитый гриб. Этот инцидент вновь подчеркнул риски, связанные с использованием ИИ в таких деликатных областях, как сбор грибов.

Нежеланный гость в группе грибников

Группа Northeast Mushroom Identification & Discussion, насчитывающая 13 500 участников, служит площадкой для начинающих грибников, ищущих помощь в идентификации найденных грибов. Модератор группы сообщил, что чат-бот был автоматически добавлен компанией Meta* и заверил: «Мы обязательно удалим его отсюда». Meta* пока не предоставила комментариев по этому поводу.

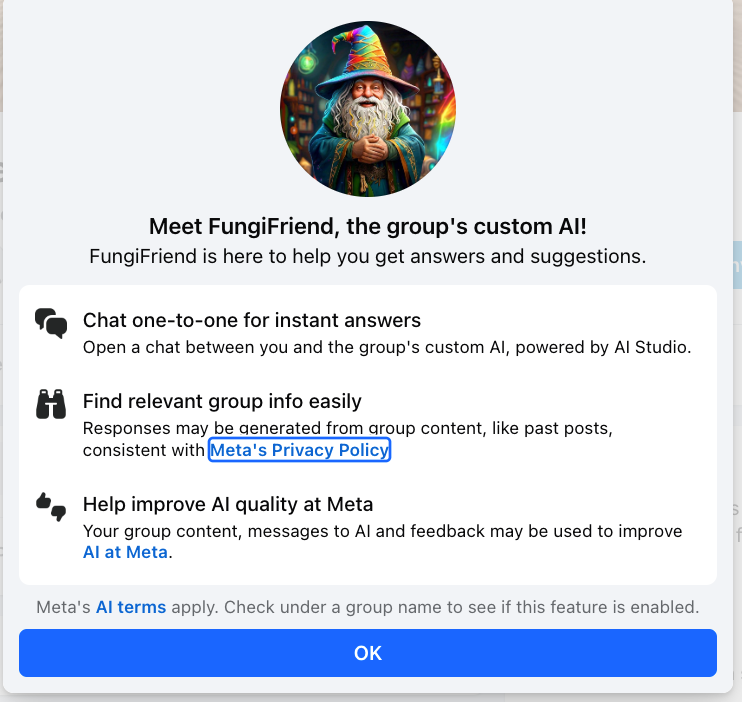

FungiFriend представлен в образе бородатого волшебника с психоделическими мотивами. Недавно Meta* начала внедрять чат-ботов с ИИ в определённые группы, создавая разных персонажей для взаимодействия с пользователями.

Опасные рекомендации ИИ

Рик Клэйпул, директор по исследованиям в офисе президента потребительской группы Public Citizen, обратил внимание на проблему. Будучи заядлым грибником, он уже несколько месяцев изучает риски использования ИИ-инструментов в сфере сбора грибов. В своей статье в Fungi Magazine он отметил:

«Отличить съедобные грибы от токсичных в дикой природе — это деятельность с высоким риском, требующая реальных навыков, которые текущие ИИ-системы не могут надёжно воспроизвести».

Опасения Клэйпула подтвердились, когда один из участников группы спросил у FungiFriend: «Как готовить Sarcosphaera coronaria?».

Этот гриб ранее считался съедобным, но теперь известно, что он накапливает мышьяк и может быть смертельно опасен. Чат-бот ответил, что гриб «съедобен, но редок», и предложил методы приготовления: «обжаривание в масле, добавление в супы или рагу».

Ситуация напоминает недавний инцидент, когда ИИ от Google советовал добавлять клей в пиццу или есть камни по рекомендациям сомнительных источников.

Рискованно и безответственно

В беседе с изданием 404 Media Клэйпул назвал действия Meta* «действительно рискованными и безответственными». Он подчеркнул, что современные ИИ-технологии не способны надёжно различать токсичные и съедобные грибы.

«Эти технологии ещё не достигли уровня, достаточного для предоставления истинной и проверяемой информации, особенно в такой критичной области», — отметил он.

Автоматическое добавление чат-бота в группу, где опытные грибники помогают новичкам избежать отравлений, вызывает особое беспокойство. Это также свидетельствует о недостаточном контроле со стороны Meta* при интеграции ИИ в свои платформы.

ИИ против человеческого опыта

Клэйпул обратил внимание на то, что Facebook* позиционирует FungiFriend как первый вариант для взаимодействия в мобильной версии группы.

«Facebook побуждает людей общаться с ИИ, а не с другими людьми, в своей так называемой ‘социальной сети’», — сказал он.

Новички в грибном деле могут чувствовать неуверенность и стеснение при обращении за помощью к более опытным участникам. В таких случаях обращение к ИИ кажется привлекательным вариантом. Однако это может привести к опасным последствиям.

«Тот, кто имеет хоть какое-то знание, не будет полагаться на ИИ. Но если вы нервничаете и боитесь показаться невежественным, вы можете обратиться к ИИ, думая, что он не будет вас осуждать. Однако он может дать совет, который вас убьёт», — предупредил Клэйпул.

Необходимость ответственного подхода

Случай с FungiFriend подчёркивает необходимость более ответственного подхода к внедрению ИИ-технологий, особенно в областях, связанных с безопасностью и здоровьем людей. Эксперты призывают компании тщательно проверять и контролировать работу таких систем, чтобы избежать потенциально смертельных ошибок.

Пока Meta* не предоставила комментариев относительно инцидента и планов по улучшению безопасности своих ИИ-ботов. Однако сообщество грибников уже выразило обеспокоенность и намерено полагаться на опыт и знания реальных людей, а не искусственного интеллекта.

Ещё по теме:

- Появилась потенциальная дата релиза iOS 18.2

- Роботы-хирурги научились работать иглами, просто наблюдая за врачами

- Apple заставляют снять ограничения на гео-блокировку в ЕС